感知就是从输出到输入,中间构建阈值,可以实现布尔运算,阈值也可以是硬阈值或者软阈值,甚至是一个函数。线性函数拓展到布尔运算,形状不过是多个叠加条件。拓展到多维,运用微积分的思想,可以模拟任何函数。

¥

支付方式

请使用微信扫一扫 扫描二维码支付

请使用支付宝扫一扫 扫描二维码支付

Neural Network is modelling the brain.

- group of Perceptorns, Multi-layer Perceptorn can slove XOR problem.

How to train this complex model ?

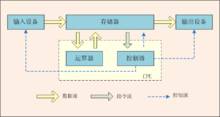

如何定义现代计算机的架构呢?

冯诺伊曼结构

当前的神经网络模型都属于连接机器。

————————————————————

里程碑之一:

兴奋性突触:能够激发神经元的突触,如果有足够的刺激,它们就会被激发。

抑制性突触:当一些信号传递过来,这个不会被激发,不管传递过来的是什么。

————————————————————

感知机模型:

simplified mathematical model

模型思想:如果你有一些输入元素进入一个网络单元,这个单元会以权重组合的方式操作这些输入。如果权重组合超过了一个阈值,这个神经元就会被激发,否则就不会被激发。

这个非常简单的结构是非常全能的。

Rosenblatt提出一种学习算法:

如果目前输出与期望输出不匹配,这两者的差异将会与当前输入相乘,并加到当前的权重上面。这种学习规则非常流行,在机器学习中,无时无刻都会用到。

感知机无法解决异或XOR问题。

单独的感知机单元的计算能力有限。但是如果组织成网络,计算能力就会非常强!

上述均是布尔学习模型。但我们的大脑不是布尔机器,我们的大脑输入基于各种实数。

————————————————————

感知机是可以处理实数输入的。

可以使用简单的线性函数模拟出布尔函数,而且可以通过对各种布尔函数的组合来构建无限的可能来完成给定的布尔型任务。

一旦你知道其工作原理,就能够构建任意复杂的布尔函数。

————————————————————

complex decision boundaries:如何设计网络?

应该把复杂的形状,拆解为多个一般性的基本凸函数图形,这样就能让每个子网络处理一个凸函数图形,然后将它们组合起来,来形成任意的复杂决策边界。

处理图像分类的情况:也是如此,神经网络的作用就是学习到这两个向量领域在高维的分界线。

————————————————————

总结:多层感知机能够连接多个计算模型以此来耦合复杂的布尔函数,但它本质上还是布尔模型,只是通过各种不同的线性函数的组合来实现这一点。

MLP能代表任意形状决策边界,MLP可以用来分类数据。

————————————————————

MLP——regression

如果想要的输出是连续的实数,而不是之前的布尔型0或者1,应该怎么做?

可以对任意函数进行建模。我们可以将这个函数理解为序列函数。可以让隐含层的感知机两两配对,每一对来配合某个阶跃函数在某个区域内的高度。然后以从左到右的顺序,总能得到一个输出值。甚至!可以让这种近似来得更加精确,即,让每个区间更窄,产生更多的区间。

总结:MLP作为连接型计算模型,是可以用来处理分类任务的,MLP同样可以用来对连续型函数进行建模。

神经网络其实就是多层感知机(MLP)。

MLP具有一定的记忆机制,目前看到的都是MLP的前向feedforward工作,但是,有一些循环网络,这种网络的某个单元输出会回到单元本身。

对神经网络进行计算:对概率分布进行计算等等。

AI任务只是一些能被神经网络建模的函数。

第二课笔记:本节课主要介绍了神经网络的发展历史。起源于对大脑神经元的模仿,最开始只是简单的单独感知机模型,可以完成与或非布尔运算,但是不能完成异或运算。之后将感知机组成网络,多层感知机就出现了!多层感知机可以联结多个计算模型以此来耦合复杂布尔函数。之后的发展便是从布尔型机器,到可以处理实数,从硬阈值到软阈值,至此MLP(多层感知机)可用于图像分类,甚至是复杂函数的拟合。

所谓往往越简单的越是强大!小小的感知机在组成MLP后,会有很强大的功能。

1导论部分讲了神经网络(多层感知器)的历史,从连接机器与冯诺依曼机讲起,再到bool型感知器能够模拟或且非逻辑运算。通过增加1层感知器获得更复杂的运算(异或),进而证明了三层感知器可以计算任意布尔运算。同时,学习算法也从赫伯型到广义赫伯型,进而发展到Rosenblatt学习算法。

2将拟合的布尔函数的输入从布尔拓展到实数,进而能表示复杂的决策边界,能对多分类问题进行判别。

3感知器感知什么?感知X和W的夹角,越接近相应越大。单个感知器是检测输入模式的相关性滤波器,MLP是级联的特征检测器。

4神经网络是函数

传统计算机为处理器和数据分离,数据在内存中,但是连接机器数据分布在整个系统中,有时候改动其中的数据,会改动整个系统。

神经网络属于连接机器,本质是多层感知机,其特点为多单元,多链接,信息隐藏其中。

多层感知机最初的研究集中在模拟各种布尔运算,但是问题在于结构上无法模拟复杂的布尔运算,无法进行数值计算。

后来证明可以用多层网络机制解决复杂的布尔运算,而简单的线性函数可以耦合出布尔函数,利用布尔函数可以构建不同的规则。

这样多层感知机就可以耦合各种不同的情况,复杂的情况可以分割为各种凸包的组合进行处理。

在连接性的机器之中,知识、经验是呀不同元素之间的连接作为存储的方式的。

对于连接性系统的要求:神经单元之间的连接;每一个神经元的激活函数;修改神经元之间连接的学习规则;以及如何从语义方面对网络进行解释。

多层感知机可以随意的完成复杂的布尔函数。对于输入和输出值为任意实数的情况下,多层感知器也能完成。

多层感知器被用来完成分类任务,每一个单独的感知器可以被当做特征提取单元。多层感知器同样可以用来处理连续的实数函数。每一个多层感知器的权重相当于固定模型的模板,因此感知器可以当做特征的滤波器进行试验。

1.2 神经计算的历史和认知基础

1.冯·诺依曼体系结构

2.神经元(大脑中的信息连接、处理单元)

细胞体(细胞核、细胞膜、细胞质)和突起(树突、轴突、轴突末梢)

3.感知机 Perceptron(模拟人类视神经控制系统的图形识别机)

4.布尔函数 0 1 与或非 同或 异或 组合 其他逻辑运算

5.输入 权重 参数 运算 输出 阈值比较

激活函数

阙(que一声)值,阈(yu四声)值,阀(fa二声)值。正规用法为阈值。意为 “临界值”。是指一个效应能够产生的的最低值或最高。

多层感知机(MLP):映射一组输入向量到一组输出向量

6.神经网络的建模

7. 好好学英语!好好学英语!好好学英语!

可以通过各种布尔函数的组合来构建无限的可能来完成给定的布尔型任务。把复杂的形状,拆解为多个一般性的基本凸函数图形,这样就能让每个自网络处理一个凸函数图形,然后把他们整合起来,形成任意的复杂决策边界。

多层感知机能够联结多个计算模型以此来耦合复杂的布尔函数。

客服1

客服1

官方群

官方群