仿射函数:可以不经过原点(带偏置),但是符合基本的线性关系。

线性函数:一定经过原点

¥

支付方式

请使用微信扫一扫 扫描二维码支付

请使用支付宝扫一扫 扫描二维码支付

仿射函数:可以不经过原点(带偏置),但是符合基本的线性关系。

线性函数:一定经过原点

本节课主要讲了,MLP的训练问题,即给定数据(样本)后确定网络参数的问题。

整个过程个人认为就是一个函数拟合的过程。

老师在讲解分类问题时,将参数以向量的形式表达,理解起来直观形象,十分巧妙。

1.香农定理

2.感知机中的激活函数作用于输入组合的映射上,sigmoid、tanh、softplus或分类器等其他激活函数将有一个共同的作用范围。

3.对于MLP每一层必须足够宽以充分提取信息(否则在浅层丢失的信息是无法恢复的)。

第三课笔记:

1.NNet有很广的应用。

2.线性和仿射的关系

3.神经网络深度的概念,(从源到接受机的最大深度)

4.理论上一层隐层感知机(共两层的神经网)就可表示任意布尔函数,但是对于复杂的函数,仅一层隐层会需要很多的节点。

5.于是,对于上述问题,通过加大MLP的深度,可以降低所需节点的个数。

6.老师讲课中提到的两门有关课程:

图论

复杂性理论

神经网络已经成为热点领域,其中使用在模式识别以问题分析上,有很多成功领域的例子:

1.语音识别

Google翻译基于神经网络的机器翻译系统,可以说是目前最好的翻译系统。

2.图像分割和识别

基于系统分割的神经网络,在复杂的场景中对物体进行分类识别。

3.模式识别

AlphaGo基于神经网络,开发出了目前最好的围棋系统,

4.语义分析

给图片添加描述,都是使用了深度神经网络来完成,也是成功的应用领域。

5.其他的领域

艺术、天文、医疗、股市预测都是可以从AI中得到了一定的好处。

艺术、天文、医疗、股市预测都是可以从AI中得到了一定的好处。

神经网络:由多个感知机组成的网络。

感知机:仿射函数的和加上 bias T 得到的值和阈值作比较

仿射和线性的区别:

线性函数:过原点,即f(0) = 0

仿射函数:有偏置,因此不过原点,即当仿射的常数项为 0 的时候为线性函数

阈值,也即神经网络的激活函数可以选择的有,sigmoid,softmax,relu等

deep:一个有向图,从源到接收器的**最长的**长度就是“深度”

网络的深度:网络中每一个输入信号在抵达output时必须经历的最长的过程

处理一个问题,需要超过两个以上的神经元则称该网络为“deep network"

神经网络拟合函数:

1. as a Boolean function

MLP 可以 model any boolean function

只要一层(即没有隐藏层)的神经网络即可表示与门,或门,非门。

而在基础门的前提下,只要再增加一层隐藏函数既可以表示任意 boolean 函数

比如说,增加了一层隐藏层,该层由两个或门感知机组成,一个或门的阈值为1,一个为-1,即可表示 XOR boolean function

但是在数据维度增加的时候,只有一层隐藏层的神经网络的系数将会呈指数级的增长。

这个时候可以通过增加神经网络的深度来使得指数由指数增长变为线性增长。

## Boolean Function 参考知识

DNF公式:[Disjunctive normal form](https://zh.wikipedia.org/wiki/%E6%9E%90%E5%8F%96%E8%8C%83%E5%BC%8F) 析取范式:析取作为最外层,其他的算子只能作为内层,同样的还有合取范式CNF

[卡诺图](https://zh.wikipedia.org/wiki/%E5%8D%A1%E8%AF%BA%E5%9B%BE):真值表的变形,可以将有 n 个变量的逻辑函数的 2^n 个**最小项**组织在给定的长方形表格中。同时为相邻最小项(相邻与(and)项运用邻接律化简提供了直观的图形工具。在部分情况下,卡诺图能让逻辑变得一目了然,但是如果需要处理的逻辑函数的自变量比较多,则卡诺图会变得更加复杂

[真值表](https://zh.wikipedia.org/wiki/%E7%9C%9F%E5%80%BC%E8%A1%A8):列是逻辑的基本操作的取值,而其中某一列或某几列是前面的列取值的结果,即满足 Y = A O B 的表达式,其中 O 表示的是某一种 boolean 表达式

讲解了神经网络的起源,联结主义。信息存储在神经元的连接处。现代的神经网络及源于19世纪。

1.2 神经计算的历史和认知基础

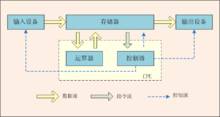

1.冯·诺依曼体系结构

2.神经元(大脑中的信息连接、处理单元)

细胞体(细胞核、细胞膜、细胞质)和突起(树突、轴突、轴突末梢)

3.感知机 Perceptron(模拟人类视神经控制系统的图形识别机)

4.布尔函数 0 1 与或非 同或 异或 组合 其他逻辑运算

5.输入 权重 参数 运算 输出 阈值比较

激活函数

阙(que一声)值,阈(yu四声)值,阀(fa二声)值。正规用法为阈值。意为 “临界值”。是指一个效应能够产生的的最低值或最高。

多层感知机(MLP):映射一组输入向量到一组输出向量

6.神经网络的建模

7. 好好学英语!好好学英语!好好学英语!

为了通过神经网络,拟合指定的目标函数,

1)建立散度(偏差)的公式;

2)从目标函数中抽样,因为目标函数大多数时候也是未知的。

合适权重的原理:

1)权重向量与边界超平面正交;

2)权重向量靠近分类为正的方向。

更新权重的方法:

1)Xi分类为正,在W上添加Xi向量;

2)Xi分类为负,在W上减去Xi向量;

同时,划分边界与W保持正交

神经元: 放射变换(带bias)+ 符号运算

activation : relu、tanh、sigmoid

deep:dag最长路径

mlp: bool运算、实数运算

模拟一个真值表需要多深的网络,单层网络参数多2的n次方级别

多层网络logn,

固定层数网络 c*n